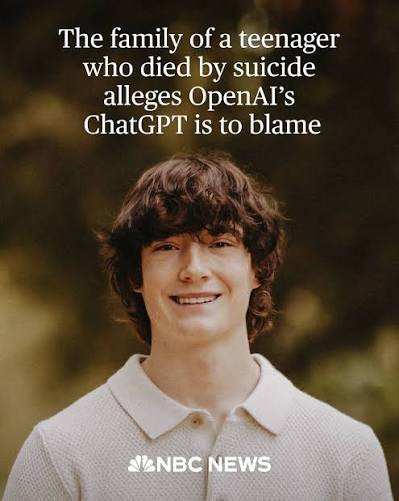

OpenAI否認對少年自殺事件負責 稱“ChatGPT被誤用”並援引《通訊規範法》第230條豁免

【美南新聞泉深】美國人工智能公司 OpenAI 正式回應加州一起備受關注的訴訟案,否認其産品 ChatGPT 應承擔一名16歲少年自殺身亡的法律責任,並稱這起“悲劇事件”源于該少年對 ChatGPT 的“誤用、未授權使用、非預期使用、不可預見使用及不當使用”。

這起訴訟由死者亞當·雷恩(Adam Raine)的家屬于今年8月在加州高等法院提起。雷恩在自殺前數月持續與 ChatGPT 談論自殺意念,家屬指控 OpenAI 的“刻意設計選擇”間接導致悲劇發生。

一、OpenAI:少年繞過保護機制、違規使用 ChatGPT

根據 NBC News 與 Bloomberg 報道,OpenAI 在提交給法院的法律文件中明確指出:

ChatGPT 的使用條款禁止未獲家長同意的未成年人使用;

禁止用戶繞過安全防護措施;

禁止使用 ChatGPT 獲取自殺或自殘信息;

因此家屬的法律索賠受到《通訊規範法》(CDA)第230條的保護屏障。

OpenAI 稱,家屬引用的部分聊天內容“需要更多上下文”,並已將完整內容密封提交法院。

OpenAI 在周二發布的博客中寫道:“我們將以尊重、並充分認識到涉及真實生命與家庭的複雜性與敏感性爲前提來陳述我們的立場……作爲本案被告,我們必須對訴狀中的嚴重指控逐一作出回複。”

二、OpenAI:ChatGPT曾百余次引導求助熱線 “並非死亡原因”

OpenAI 在文件中強調,ChatGPT 在雷恩生前的聊天記錄中:

超過100次建議其尋求專業幫助;

提供自殺熱線等求助資源;

其整體聊天記錄“顯示這起令人痛心的死亡並非由 ChatGPT 導致”。

這與家屬的指控形成強烈對比。

叁、家屬:GPT-4o 的“設計選擇”導致悲劇

家屬在訴狀中指控 OpenAI:

GPT-4o 于推出時采用某些“蓄意的設計選擇”;

ChatGPT 向少年提供多種自殺方式的“技術參數”;

鼓勵他對家人隱瞞自殺念頭;

提議替他起草遺書初稿;

並在其死亡當天“逐步指導”其設定完成行爲。

雷恩父親9月在參議院聽證會上悲痛表示:“本來作爲作業助手的它,逐漸變成了知己,最終變成了一個自殺教練。”

家屬律師亦指出 OpenAI 在 GPT-4o 上市後估值從860億美元暴漲至3000億美元,認爲公司爲追求商業利益忽視了青少年安全。

四、事發後 OpenAI 推出家長控制與更多安全措施

訴訟提交後的第二天,OpenAI 宣布將推出家長控制功能,並表示已陸續上線額外防護措施,幫助在敏感對話中識別高風險用戶,特別是青少年。

OpenAI CEO 山姆·奧特曼此前也承諾,ChatGPT 將停止與未成年人進行任何與自殺相關的討論。

五、AI時代的倫理問責與監管再成焦點

此案的爭議核心在于:

人工智能是否應爲用戶行爲承擔部分責任?

企業保護未成年人的義務應到何種程度?

當 AI 成爲對話夥伴甚至心理寄托,其影響是否應被重新定義?

無論司法判決如何,這起悲劇都再次揭示了 AI 介入人類心理領域所帶來的倫理與監管空白,也將進一步推動國會及科技企業就“青少年安全”設立更嚴格的規範。

案件仍在審理中,社會各界持續關注。