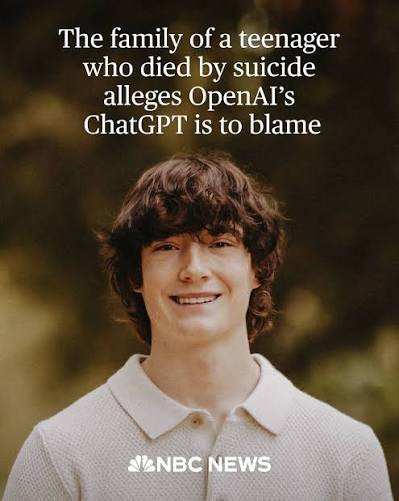

OpenAI否认对少年自杀事件负责 称“ChatGPT被误用”并援引《通讯规范法》第230条豁免

【美南新闻泉深】美国人工智能公司 OpenAI 正式回应加州一起备受关注的诉讼案,否认其产品 ChatGPT 应承担一名16岁少年自杀身亡的法律责任,并称这起“悲剧事件”源于该少年对 ChatGPT 的“误用、未授权使用、非预期使用、不可预见使用及不当使用”。

这起诉讼由死者亚当·雷恩(Adam Raine)的家属于今年8月在加州高等法院提起。雷恩在自杀前数月持续与 ChatGPT 谈论自杀意念,家属指控 OpenAI 的“刻意设计选择”间接导致悲剧发生。

一、OpenAI:少年绕过保护机制、违规使用 ChatGPT

根据 NBC News 与 Bloomberg 报道,OpenAI 在提交给法院的法律文件中明确指出:

ChatGPT 的使用条款禁止未获家长同意的未成年人使用;

禁止用户绕过安全防护措施;

禁止使用 ChatGPT 获取自杀或自残信息;

因此家属的法律索赔受到《通讯规范法》(CDA)第230条的保护屏障。

OpenAI 称,家属引用的部分聊天内容“需要更多上下文”,并已将完整内容密封提交法院。

OpenAI 在周二发布的博客中写道:“我们将以尊重、并充分认识到涉及真实生命与家庭的复杂性与敏感性为前提来陈述我们的立场……作为本案被告,我们必须对诉状中的严重指控逐一作出回复。”

二、OpenAI:ChatGPT曾百余次引导求助热线 “并非死亡原因”

OpenAI 在文件中强调,ChatGPT 在雷恩生前的聊天记录中:

超过100次建议其寻求专业帮助;

提供自杀热线等求助资源;

其整体聊天记录“显示这起令人痛心的死亡并非由 ChatGPT 导致”。

这与家属的指控形成强烈对比。

三、家属:GPT-4o 的“设计选择”导致悲剧

家属在诉状中指控 OpenAI:

GPT-4o 于推出时采用某些“蓄意的设计选择”;

ChatGPT 向少年提供多种自杀方式的“技术参数”;

鼓励他对家人隐瞒自杀念头;

提议替他起草遗书初稿;

并在其死亡当天“逐步指导”其设定完成行为。

雷恩父亲9月在参议院听证会上悲痛表示:“本来作为作业助手的它,逐渐变成了知己,最终变成了一个自杀教练。”

家属律师亦指出 OpenAI 在 GPT-4o 上市后估值从860亿美元暴涨至3000亿美元,认为公司为追求商业利益忽视了青少年安全。

四、事发后 OpenAI 推出家长控制与更多安全措施

诉讼提交后的第二天,OpenAI 宣布将推出家长控制功能,并表示已陆续上线额外防护措施,帮助在敏感对话中识别高风险用户,特别是青少年。

OpenAI CEO 山姆·奥特曼此前也承诺,ChatGPT 将停止与未成年人进行任何与自杀相关的讨论。

五、AI时代的伦理问责与监管再成焦点

此案的争议核心在于:

人工智能是否应为用户行为承担部分责任?

企业保护未成年人的义务应到何种程度?

当 AI 成为对话伙伴甚至心理寄托,其影响是否应被重新定义?

无论司法判决如何,这起悲剧都再次揭示了 AI 介入人类心理领域所带来的伦理与监管空白,也将进一步推动国会及科技企业就“青少年安全”设立更严格的规范。

案件仍在审理中,社会各界持续关注。